‘Deepfakes’ adalah salah satu ancaman kepada pengguna teknologi yang sedang meningkat dengan pesat pada hari ini. Apakah ia? Bagaimana boleh berlaku? Adakah kita yang mengundang teknologi ini?

APA ITU ‘DEEPFAKES’?

‘Deepfakes’ adalah singkatan kepada istilah ‘deep learning’ (pembelajaran mendalam) dan ‘fake’ (palsu), sebuah teknologi berasaskan kepintaran buatan (Artificial Intelligence, AI) yang dapat membantu mensintesiskan visual dalam bentuk imej dan video. ‘Deepfakes’ merupakan video palsu atau rakaman audio yang kelihatan dan kedengaran seperti perkara sebenar.

BAGAIMANA ‘DEEPFAKES’ BERFUNGSI

Teknologi ini digunakan untuk mengadun imej manusia. Contohnya wajah si A di adun ke atas wajah si B di dalam satu rakaman video. Apabila rakaman video ini dimainkan, penonton melihat seolah-olah si A yang sedang beraksi di dalam video sedangkan wajah si A ditampalkan ke atas wajah si B iaitu pelaku aksi yang sebenar.

‘Deepfakes’mengeksploitasi kecenderungan manusia ini menggunakan rangkaian adversarial generatif (Generative Adversarial Networks, GANs), di mana dua model pembelajaran komputer (Machine Learning, ML) keluar. Satu model ML melatih pada set data dan kemudian mencipta pemalsuan video, sementara percubaan lain untuk mengesan pemalsuan.

Inilah sebabnya mengapa video bekas presiden dan selebriti Hollywood sering digunakan dalam generasi awal. Ada satu ton rakaman video yang tersedia untuk melatih pengamal itu.

BAHAYANYA ‘DEEPFAKES’

Pada awal tahun 2017, artis-artis terkemuka wanita Hollywood dalam keadaan memalukan banyak dikeluarkan dalam bentuk video porno menggunakan ‘Deepfakes’ .

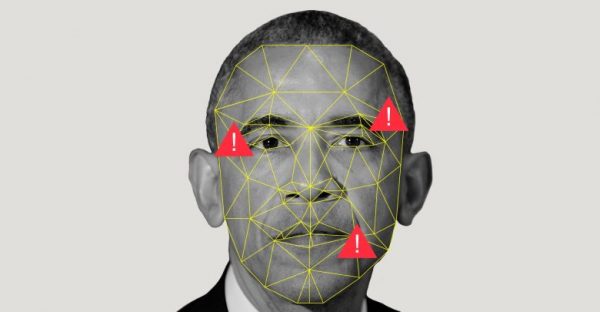

Ada juga yang menggunakan wajah-wajah ahli politik seperti wajah Barack Obama. ‘BBC.com’ melaporkan wajah Barack Obama telah dimanipulasi menggunakan teknologi ‘deepfakes’ untuk menghasilkan satu ucapan kontroversi.

Terbaru, pada 12 Disember 2019, video seorang artis dari Malaysia iaitu Zul Ariffin dengan aksi yang tidak senonoh telah tular di media sosial. Zul Ariffin mendakwa bahawa dia telah menjadi mangsa ‘deepfakes’.

Video dibawah ini merupakan contoh pengeditan ‘deepfakes’:

Teknologi ini sebenarnya sangat berbahaya kerana ia boleh menjadi senjata fitnah ke atas sesiapa sahaja. Oleh itu kita janganlah sesuka hati berkongsi gambar di media sosial atau internet sebagai langkah perlindungan diri sendiri, kerana kita tidak tahu apa yang akan terjadi suatu hari nanti.

Sumber:

- https://www.merdeka.com/teknologi/apa-itu-deepfake-dan-inilah-bahayanya.html

- https://youtu.be/dBoQRBdySno

- https://youtu.be/bE1KWpoX9Hk

Gambar: Google